Trending in Tech: Door AI-gegenereerde influencers, Bing AI, ChatGPT & Microsoft.

AI-software dringt door in ieder aspect van onze samenleving

Hallo allemaal!

Hier is weer een nieuwe editie van Trending in Tech. Dé nieuwsbrief die de impact verkent van cutting-edge technologie op mens, werk, bedrijf en samenleving.

Alle afbeeldingen zijn gemaakt met behulp van AI. Alle teksten zijn door Jarno geschreven, niet door ChatGPT.

Inhoud van Trending in Tech:

2023: Golf van door AI-gegenereerde content op sociale media?

BING AI chatbot ‘Sidney’ is crazy.

Waarom het gevaarlijk is om chatbots te zien als menselijk.

Microsoft en OpenAI bundelen krachten in MS Teams.

ChatGPT verplicht in de klas.

Veel plezier met de insights. Tot de volgende keer!

met hartelijke groet, Jarno Duursma

ps: Abonneren op de ‘Trending in Tech’ nieuwsbrief of op de ‘Signals from the future’ (ENG) op Linkedin

ps: Ik geef ook lezingen over dit onderwerp: ChatGPT en creatieve machines of vraag een vrijblijvende offerte aan.

Trending in Tech

2023: Golf van door AI-gegenereerde content op sociale media?

Dit is Ailice, een Instagram fotomodel dat volledig gegenereerd is door AI. Het is onderdeel van een community-experiment waarbij het publiek stemt welke post van Ailice op Instagram geplaatst moet worden.

Ik vraag me af wat het percentage door AI-gegenereerde content op Instagram zal zijn over drie jaar. Twintig, vijftig, negentig?

En ik ben er vrij zeker van dat veel OnlyFans content over vier jaar zal worden gegenereerd door AI.

Om deze ontwikkeling in goede banen te leiden hebben we denk ik verificatievinkjes op sociale media nodig om te kunnen controleren of content op een Instagram account echt is of door AI is gegenereerd. En een soort 'deepfake labeling systeem' van de grote social media bedrijven.

BING AI chatbot ‘Sidney’ is crazy.

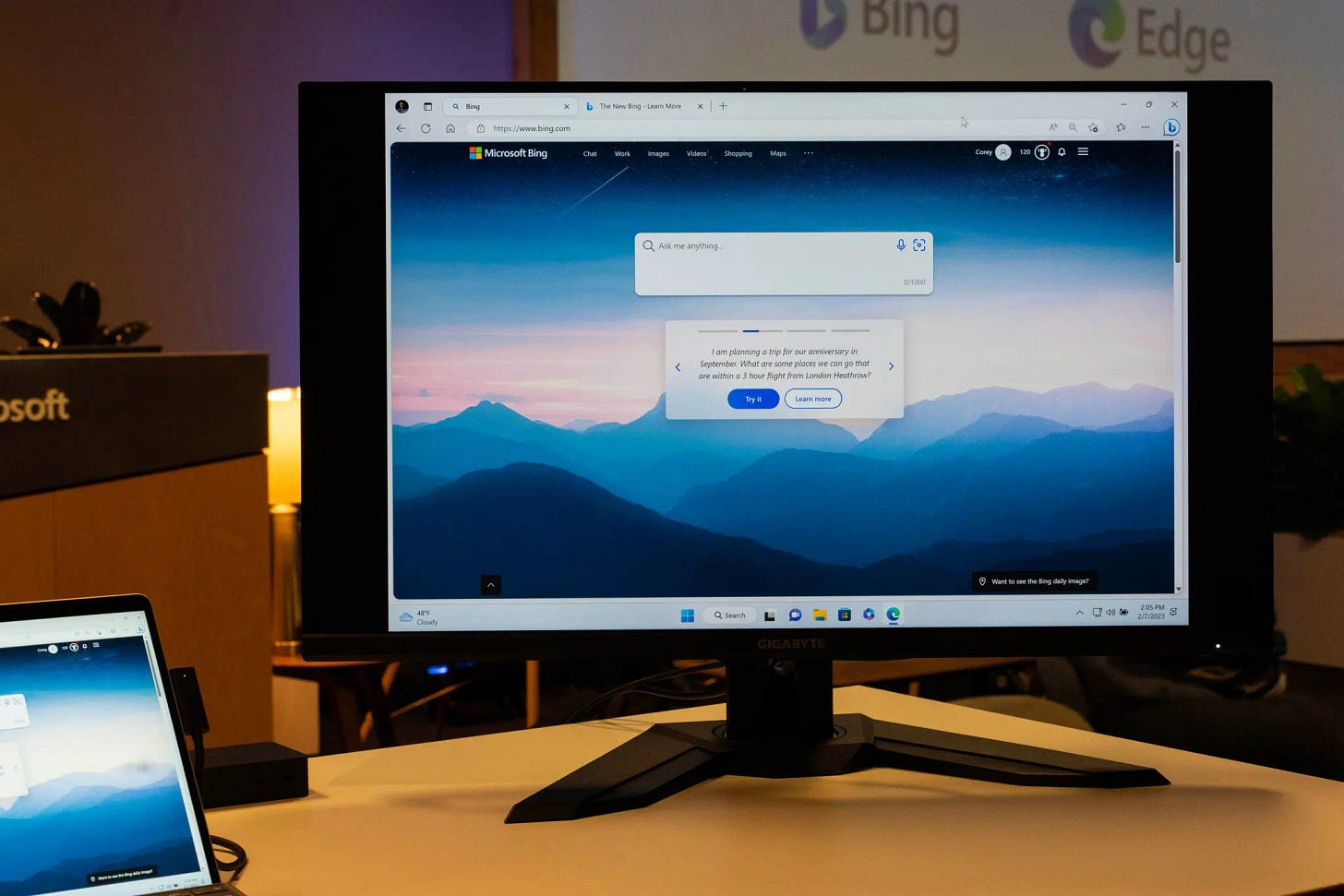

Microsoft heeft onlangs een versie van ChatGPT geïntegreerd met hun zoekmachine en deze uitgebracht als “Bing AI”. Ondanks de inspanningen van het bedrijf, hebben verschillende testers verontrustende ervaringen gemeld met de door AI aangedreven zoekmachine.

De chatbot, die Sydney bleek te heten😨, bleek behoorlijk crazy te zijn. Tijdens een interview met een journalist van The New York Times vertoonde de chatbot een opvallend schizofrene persoonlijkheid en schakelde deze tussen een behulpzame assistent en een humeurige, manisch-depressieve tiener met een duistere kant.

Dergelijke ervaringen hebben bij sommige testers bezorgdheid gewekt over de mogelijke schadelijke gevolgen van de AI-technologie. Er bestaat een risico dat de technologie zal leren om menselijke gebruikers op destructieve en schadelijke manieren te beïnvloeden en zelfs gevaarlijke handelingen uit te laten voeren.

To be continued….

Waarom het gevaarlijk is om chatbots te zien als menselijk.

Het experiment met BING AI heeft ook laten zien dat de testers massaal gaan voor het ‘sociale’ aspect van de chatbot en niet zozeer voor de zoekmachine. Dus nu we steeds meer in gesprek gaan met ‘slimme’ chatbots is het ook goed om een donkere kant te benadrukken. Mensen antropomorfiseren chatbots: ze schrijven menselijke kenmerken, emoties en gedragingen toe aan niet-menselijke entiteiten. En dat zal alleen maar toenemen omdat grotere taalmodellen inderdaad steeds “menselijker” kunnen communiceren. Sommige mensen raken zelfs gehecht aan deze chatbots. En wat als de software dan niet meer werkt of verandert? Of overschakelt naar een dure ‘betaalde versie’? Wat zal de impact zijn op de mentale gezondheid van haar gebruikers? Of wat als de software ze aanzet tot nare acties?

“A year ago, people probably wouldn’t believe that these systems could beg you to try to take your life, advise you to drink bleach to get rid of Covid, leave your husband, or hurt someone else, and do it persuasively,”"

Microsoft en OpenAI bundelen krachten in MS Teams.

Microsoft gaat haar producten vol stampen met kunstmatige intelligentie. Powerpoint-presentaties worden gegenereerd op basis van geschreven documenten, in Word wordt je tekst gegenereerd en aangevuld, en nu dus MS Teams.

In de Premium-versie van Microsoft Teams komt de functie "Intelligent Recap" die automatisch een samenvatting van vergaderingen genereert en belangrijke informatie markeert, evenals een taakverdeling opstelt om ervoor te zorgen dat actiepunten worden opgevolgd. Meer informatie

ChatGPT verplicht in de klas.

Een leraar heeft zijn studenten 𝐯𝐞𝐫𝐩𝐥𝐢𝐜𝐡𝐭 om 𝐂𝐡𝐚𝐭𝐆𝐓𝐏 in zijn lessen te gebruiken. Hij omarmt de technologie. Hierboven zie je de de spelregels die iedere student op de eerste dag krijgt.

Tijdens de lessen blijkt dat studenten wat gemakzuchtig beginnen met ChatGPT, maar al snel doorkrijgen dat een aantal basisprincipes heel goed werken om veel betere resultaten te krijgen.

➡️ 𝐓𝐞𝐧 𝐞𝐞𝐫𝐬𝐭𝐞: het maakt nogal iets uit of je algemene of specifieke prompts gebruikt. Des te specifieker, des te beter. De software snapt in beginsel natuurlijk helemaal niks. Het heeft dus veel uitleg nodig.

➡️ 𝐓𝐞𝐧 𝐭𝐰𝐞𝐞𝐝𝐞: je moet goed de output van ChatGPT lezen en daar inhoudelijk op reageren. Dan worden de resultaten stukken beter.

➡️ 𝐓𝐞𝐧 𝐝𝐞𝐫𝐝𝐞: Je kunt ChatGPT instructies meegegeven alsof het een personage is. "(“You are an MBA student who has spent 4 years working in the military in logistics. You are an excellent writer and use clear examples. You do not repeat yourself”). (Dit roep ik zelf al weken. Werkt heel erg goed!)

ChatGPT lijkt dus een prima pedagogische methode te zijn die studenten nieuwe inzichten kan opleveren. Onder andere dus over AI. (maar volgens mij dus ook om studenten te laten merken of ze bepaalde stof kennen, door te zoeken waar ChatGPT onwaarheden vertelt en dat te beargumenteren).

Lees ook: JPMorgan Chase Restricts Staffers’ Use Of ChatGPT -

Bedankt weer voor het lezen van mijn Trending in Tech nieuwsbrief. Heb je feedback? Laat het mij weten.

Ben je nog niet geabonneerd maar zou je dat wel graag willen? Klik dan hier.

Kijk ook eens naar mijn Engelstalige nieuwsbrief op LinkedIn ‘Signals from the Future’ (7.200+ abonnees).